ChatGPTの登場からわずか数年で、ニュースのつくり方は大きく変わり始めました。正確さとスピードが求められる報道の世界において、AIは脅威なのか、それとも可能性なのか。

その問いに向き合うことは、新聞社にとって避けて通れない共通のテーマです。創刊から140年を超える歴史を持つ朝日新聞社は9月29日、「AIに関する考え方」を公表しました。

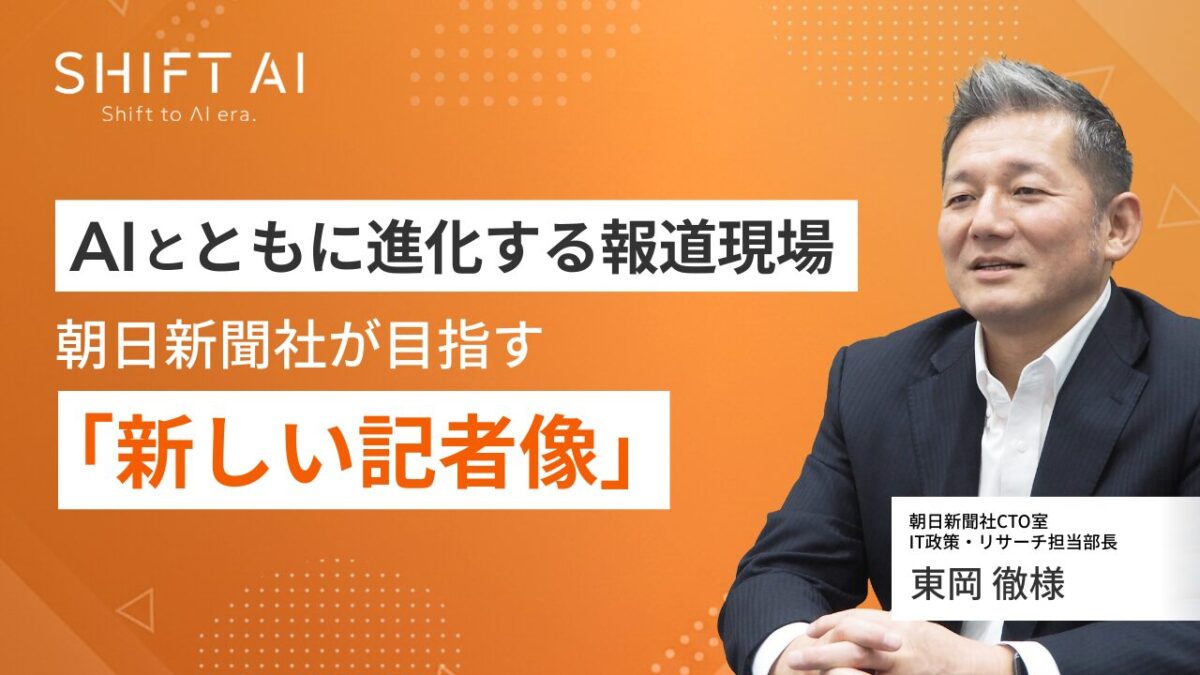

AIをどう扱い、どこまで信じ、どこから疑うのか。報道機関としての姿勢を示すことは、読者との約束を更新する行為でもあります。その背景と現在地を探るため、同社でCTO室IT政策・リサーチ担当部長を務める東岡徹氏にお話を伺いました。

株式会社朝日新聞社

朝日新聞社CTO室IT政策・リサーチ担当部長

1997年に記者職で入社。2005年から政治部。ソウル特派員、首相官邸キャップ、政治部次長、朝日新聞労働組合委員長などを歴任。現在はAI委員会事務局長も務める。趣味は草野球。ポジションはキャッチャー。

※株式会社SHIFT AIでは法人企業様向けに生成AIの利活用を推進する支援事業を行っていますが、本稿で紹介する企業様は弊社の支援先企業様ではなく、「AI経営総合研究所」独自で取材を実施した企業様です。

「必須ノウハウ3選」を無料公開

- 【戦略】AI活用を成功へ導く戦略的アプローチ

- 【失敗回避】業務活用での落とし穴6パターン

- 【現場】正しいプロンプトの考え方

朝日新聞社が「AIに関する考え方」を公表した理由

ChatGPTが登場した2022年11月以降、社会には期待と不安が同時に広がりました。AIの性能は急速に向上し、あらゆる業務で活用が進む一方、誤情報や著作権、透明性といった新しい課題も噴出しました。

新聞社にとって、この変化は単なる技術進化の話ではありません。記事の作り方、読者との関係、メディアの信頼性――そのすべてに直結する大きな転換点になりました。東岡氏は、朝日新聞社のAIに関する考え方を公表した理由についてこう語ります。

「AIをどう使い、リスクにどう対応するのか。新聞社としての姿勢を、読者の皆さまに明確に示す必要がありました」

加えて、社内でも判断基準が求められていました。急速にAIツールが普及し、それぞれの社員が独自の理解で使い始めると、誤用や情報漏えいのリスクが高まります。

「どこまでAIに任せてよいのか、最終判断を誰が担うのか。共通の基準がないまま使い始めると、現場が混乱します。だからこそ“AIは人間を補助し、責任は必ず人間が持つ”という原則を明文化しました」と東岡氏は強調します。

「AIに関する考え方」の公表には、二つの大きな狙いがありました。

一つは、読者に対して誠実であり続けるための透明性。

もう一つは、社員が判断できるようにするための一貫性。

その両方を実現することで、朝日新聞社はAI時代のジャーナリズムを社会と共有し、変化のただ中で読者からの信頼を守ろうとしているのです。

AIは補助役であり、権力であり、監視すべき対象でもある

AIの進化によって「人間の仕事が置き換えられるのではないか」という不安が広がりました。しかし朝日新聞社は、その見方を採っていません。東岡氏は次のように述べています。

「AIは人間の代替ではありません。判断や責任は人間が担い、AIはあくまで人間を補助する役割です」

AIが自然な文章を生み出しても、誤情報が含まれている危険は残ります。もしハルシネーションが記事に混入すれば、読者との信頼は大きく揺らぐはずです。それを理解しているからこそ、同社はAIへの全面委任という選択肢を持ちません。

取材現場では、言葉の背景や空気の変化を読み取る必要があります。こうした感覚的な情報は、人間が向き合うことでしか把握できない領域です。最終判断や倫理観も、常に人間が担うべきだという考え方が根底にありました。

一方で、AIは新しい課題も生み出しています。ディープフェイクや偽情報、アルゴリズムの偏りなど、社会に大きな影響を与える現象がすでに現れ始めました。AIは利便性だけでなく、監視が欠かせない対象でもあります。東岡氏はこう話します。

「報道機関の役割は権力の監視です。その権力は従来、政治家や警察官、行政や巨大企業などでした。しかし、人間の知能を上回る可能性があるAIは新しい権力と言えます。その動向を取材し、社会に伝えることも報道の役割だと考えています」

AIを遠ざけるのではなく、盲信するわけでもない。適切な距離感を保ちながら、役割を分担していく姿勢が同社の基盤にあります。判断は人間が行い、作業はAIが支える。この構図が、朝日新聞社の立ち位置です。

取材と編集の現場で進む「変化」:AIが作業を減らし、記者の仕事を深めている

朝日新聞社の取材・編集現場では、AI導入をきっかけに日々の仕事の風景がゆっくりと変わり始めています。Microsoft Copilotをはじめ、複数のAIツールが実務に組み込まれ、記者が企画の作成や取材に使える時間が増えることが期待されています。

同社にはすでにAI基盤が整いつつあります。文書の校正を支援するTypoless(タイポレス)、記者会見取材などで録音した音声を素早く文字起こしするALOFA(アロファ)、社内で安心して利用できる生成AI「AsahiAI Chat」。そして編集工程を効率化するAI編集アシスタント「StoryHub」 が新たな実務ツールとして導入されました。

ただし、AIが生成した文章はあくまで出発点にすぎません。事実確認や文脈の補正、語感の調整といった工程は人間が必ず手を入れる必要があります。その重要性について東岡氏はこう強調しました。

「滑らかに読める文章ほど誤りに気づきにくい。だからこそ、AIの出力は慎重に扱わなければいけません」

こうして“疑いながら読む”姿勢がAI時代には求められます。それによって、AIを活用した編集スキルが磨かれるのです。

また、AsahiAI ChatやStoryHubは“アシスタント”のような存在にもなりつつあります。企画のアイデアを出したり、長文の資料から論点を整理したり、簡単な原稿を書いたりしてくれます。ただし、方向性を決めるのはあくまで記者です。

「何を書くのか、記事のどこを深掘りするのかは人間の記者が判断します。取材相手の言葉の背景を読み解くのも記者です」と東岡氏は述べました。

定型作業はAIに任せ、人間が“人間にしかできない仕事”へ集中できる環境を生み出そうとしています。取材現場で感じる微細な違和感や沈黙の意味を読み取る感性は、AIでは置き換えられません。

AIが業務の負担を減らし、記者の役割を広げる。この変化こそ、朝日新聞社でいま進んでいる大きな転換と言えます。

“説明責任”が、読者との信頼を守る

AIを使った記事制作が普及すると、読者にどこまで説明すべきかという課題が避けられなくなっています。朝日新聞社は、この課題に対して早い段階から明確な姿勢を示してきました。AIを活用した記事には、必要に応じて、その事実をきちんと記載し、制作過程の透明性を確保する方針です。

朝日新聞デジタル版の「土曜ビューワー号外」では、記事の最下部に「記事編集作業の一部で生成AIの技術を利用しています。生成された文章は編集者・記者が確認し、必要に応じて修正しています」と明記。AIによる分析を行った記事では、どのモデルを使い、どのようなプロセスを踏んだのかも丁寧に記載しています。記事の信頼性は読者との“暗黙の合意”で成り立っているため、その合意を裏切らないことを何より重視しているためです。東岡氏は、透明性の重要性をこう説明します。

「AIを使ったことを隠してしまうと、不信感を生む可能性があります。何を使い、どこまでAIが関わったかを正直に示すことが、読者との関係を守ることにつながります」

AIの活用が当たり前になっていくなかで、記事がどのように作られたかという“制作背景”そのものが、読者にとって重要な情報になりつつあります。どこまでAIが関与したかを知らせる行為は単なる手続きではなく、報道機関としての倫理に基づいた判断です。

また、透明性は「読者に誤解させない」という意味でも大きな役割を果たしています。AIが関わった部分と、記者が判断を下した部分の線引きを示すことで、記事の信頼性を維持できるのです。曖昧さが残ると、読者は「この記事は本当に人の目で確認されているのか?」という不安を抱えたまま読み進めることになります。東岡氏は、AI時代の将来的な議論についても言及しました。

「もしかしたら、いずれ“この記事は人間が書きました”と記す時代が来るかもしれません。そんな未来を想像できるくらいAIの関与が一般化していく可能性があります」

この言葉には、未来の報道スタイルに対する見通しと緊張感がにじみます。 AIがどれだけ進化しても、読者との関係は変わりません。その信頼を守るために、制作プロセスの開示は必要不可欠だと捉えています。

透明性の徹底は、“不安を減らすため”だけの取り組みではありません。AI時代のジャーナリズムにおいて、読者との新しい信頼の形を築くための鍵であり、朝日新聞社が最も重視している価値のひとつです。

読者に誠実であること。そのために、何を使い、どう作ったかを伝えること。それが、AI時代の報道における“最も古くて、最も新しい責任”と言えます。

AI活用を支える社内体制:AI委員会とAIエバンジェリスト

朝日新聞社のAI推進は、“特別な専門集団”をつくる発想ではありません。むしろ、社員一人ひとりが安心してAIを使えるよう、組織の基盤を丁寧につくることを重視しました。東岡氏はこう語ります。

「AIは一部の専門部署だけが扱うものではありません。全員が安全に使える環境を整えることが、私たちの最初の責任だと考えています」

その象徴となるのが、2025年4月に発足したAI委員会です。角田克・代表取締役社長CEOがトップに就くことで、AIに関する意思決定の軸を経営直下に置き、部門横断でルールづくりと利活用を同時に進める体制を整えました。ガバナンス(ルール・リスク管理)と利活用(実装推進)の2つを柱とし、導入のスピードと安全性を両立させています。

そして、実務面の生成AI活用促進を支えるのがAIエバンジェリストです。2年間で200名の育成を目標に、初年度は50名の育成を予定していたものの、社内から推薦が相次ぎ、結果的に約90名が集まりました。9月から開催されている月1回の研修でAIの基礎から業務への落とし込み方まで学び、各部署に戻ったあと“現場の推進役”として動いています。

9月の初回会議では、角田社長が「AIに全振りする」と宣言しました。東岡氏は、この場面を振り返り次のように述べます。

「トップが明確に覚悟を示したことで、社内の空気が一気に変わりました。AIを“使ってもいい”ではなく“どう使うかを考えよう”という雰囲気に変わったんです」

その結果、エバンジェリスト同士の情報交換も活発になり、AIを使った業務改善やアイデアが次々と共有されるようになりました。トップダウンの意思決定と現場の主体性がかみ合い、社内の生成AI活用は着実に広がりつつあります。

さらに社内イベント「AIチャレンジ2025」が企画されました。業務の効率化や新規事業のアイデアなどを全社員に募集したところ、140件もの作品が集まりました。

リスク管理の要「セーフリスト」:シャドーAIを防ぎ、安心して使える環境をつくる

AIツールは便利である一方、個人情報や著作権、セキュリティといったリスクも抱えています。特に問題となるのが、社員が個人判断で未承認のAIサービスを利用してしまう“シャドーAI”です。情報漏えいの原因になりかねず、企業にとって看過できない課題です。

そこで朝日新聞社は、安全性を確認したAIサービスをまとめた「セーフリスト」を導入しました。社員は原則として、このリストに掲載されたツールのみ利用する仕組みです。新たに使いたいサービスがある場合は、所属長を通じて申請し、ガバナンス部門がリスクの有無を判断。東岡氏は、この仕組みについてこう説明します。

「禁止するのではなく、安心して使える環境を整えることが目的でした。どのツールなら安全なのかを明確にすることで、現場が迷わずに済みます」

セーフリストは“利用制限”ではなく“利用の後押し”として機能しています。安心して使える範囲が明確になれば、社員は躊躇せずAIを活用でき、結果として社内のAI浸透が進み始めているのです。

リスクを理由にAIを排除するのではなく、安全性を担保したうえで積極的に使える環境を用意する。このバランス感覚こそが、朝日新聞社のリスク管理の特徴と言えます

AI時代でもジャーナリズムの本質は変わらない

AIが急速に高度化するなかで、「5年後、10年後の報道はどうなっているのか」という問いは、避けて通れません。しかし朝日新聞社の見立ては、AIの進化を警戒しすぎるでもなく、過剰に期待するでもない、極めて冷静な視点でした。

AIの進歩が進むほど、記者が果たすべき役割はむしろ明確になっていきました。これについて東岡氏はこう述べます。

「AIは作業を支えますが、何を問題として扱うか、どこに社会の歪みが潜んでいるかを見抜くのは人間にしかできません」

社会で起きている出来事の因果関係を探り、まだ言葉になっていない違和感をすくい取り、誰も気づいていない構造的な問題を照らす。こうした仕事は、人間の視点、倫理観、感情が深く関わる領域です。

AIが大量の情報を処理できるようになったとしても、社会の“どこに焦点を当てるか”という判断は、依然として人間の責任にとどまります。

さらに、AIは新しい形の“権力”として台頭し、その動向を監視する必要があります。アルゴリズムの偏り、偽情報の拡散、ディープフェイクの悪用。AIが引き起こす社会的影響は、今後より複雑で深刻な形で現れる可能性があります。

朝日新聞社はこの流れを踏まえ、AIを“可能性を広げる対象”としても位置づけています。東岡氏は、未来のジャーナリズムが向かう方向性をこう示しました。

「AIの能力が上がっても、社会の問題を見つけて問い直すという根幹は変わりません。むしろAIの影響範囲が大きくなるほど、記者が向き合うべきテーマは増えていくはずです」

技術が進化するほど、人間が立ち返るべき“原点”がはっきりします。現場へ足を運び、相手の言葉を丁寧に聞き取り、事実を積み重ね、判断を下す。この基本は揺るぎません。むしろ、AIが作業を効率化することで、記者は現地に足を運び、より深い取材ができるようになります。

AIは敵ではなく、記者と共に走る“伴走者”のような存在になりつつあります。ただし、その伴走者をどう使いこなすかは人間次第です。

「記者が事実関係の正確性を確認し、ニュースの価値を判断する役割を手放さない限り、ジャーナリズムの本質が揺らぐことはないでしょう」

この東岡氏の言葉が示す未来は、技術への不安よりも、人間の意思と責任に根ざした希望に近い。AIと共に働く時代にあっても、記者が向き合うべきものは、いつの時代も変わらない“社会の現実”です。

朝日新聞社から学ぶ5つのポイント

生成AIが急速に広がる中、報道機関には「AIをどう使い、どこで人間が判断するのか」という新しい課題が突きつけられています。朝日新聞社はこの問いにいち早く向き合い、AIへの姿勢を明確に示しながら、現場の実務にも段階的に取り入れてきました。

本項目では、東岡氏への取材から浮かび上がった 朝日新聞社の実践から学べる5つのポイントを簡潔にまとめます。

1. AI時代の不確実性に対して、まず“姿勢”を公表した

ChatGPT登場後、社会には期待と不安が入り混じりました。朝日新聞社は、その混乱の最中にあえて「AIに関する考え方」を公表しました。ここでの学びは、技術の採用よりも先に“向き合い方”を示す重要性です。

・AIをどう扱うのか

・どこまで信じ、どこから疑うのか

・最終判断を誰が担うのか

これらの基準を先に示すことで、社内外の迷いを減らし、後々の混乱を回避しています。

「姿勢を示すこと自体が、読者への責任だと考えました」(東岡氏)

AI導入の初手は、ツール選定でもPoCでもなく原則の共有である、と教えてくれる事例です。

2. AIは「人間の代わり」ではなく「補助」と位置づける

朝日新聞社はAIに対して極めて明確な立場をとっていました。AIが高度化すると「置き換え」ばかり議論されがちですが、同社の答えは違います。

・事実確認

・文脈の補正

・倫理的判断

・社会課題の選定

これらはAIでは担えない人間固有の領域。だからこそAIは“作業”を肩代わりし、人間が“仕事”に集中するための装置だと捉えていました。この姿勢によって、AI導入の主体が「恐れ」ではなく「価値向上」へと向かっていきます。

3. 現場を支える“AI基盤”を整備し、作業を軽量化した

朝日新聞社は、単に生成AIを導入したのではなく、現場の仕事を本当に軽くする基盤づくりに力を入れています。

使用されているツールは多層的です。

・Typoless(タイポレス):文書の校正支援

・ALOFA(アロファ):音声の文字起こし

・AsahiAI Chat:社内向け生成AI

・StoryHub:編集作業の下書き生成

これらにより、記者や編集者は“機械的な作業”から解放され、企画立案、深掘り取材といった本来の役割に集中できるようになりました。

4. トップダウンと現場の主体性を組み合わせた体制で導入を加速

朝日新聞社の特徴は、“仕組みのつくり方”に迷いがないことです。

・社長直下の AI委員会

・現場で推進役となる AIエバンジェリスト(約90名)

という二層構造を構築。

トップが意思を示し、現場が動き、相互に情報を交換する。この循環によって、AI文化が急速に根付きました。

5. 透明性を徹底し、AI時代の“新しい信頼”をつくっている

AIを使って記事を作ると、読み手は何を信じればよいのか。この不安を解消するため、同社は制作プロセスを開示する姿勢を貫いています。

・「生成AIを利用しています」と明記

・使用モデルや分析方法を記事末尾に記載

・AIと記者の役割の線引きを提示

AI時代 “結果だけ提示する”ではなく、“どう作ったか”も信頼の源泉になる。朝日新聞社はこの変化を正面から受け止め、読者に誠実であろうとしています。

これらの取り組みは、大規模な投資や独自技術を必要とせず、業種や企業規模を問わず応用可能です。特に「AI時代の不確実性に対して、まず“姿勢”の公表」「シャドーAIを防ぐ公式環境づくり」は、多くの企業がすぐに取り入れられる実践例と言えるでしょう。

朝日新聞社の事例が示すのは、生成AI定着のカギは単なるAIツールの導入ではなく、“社員が安心して日常的に使える仕組み”にあります。導入して終わりではなく、文化や制度にまで落とし込むことこそが、全社的な活用につながる近道です。

しかし、自社でこれを実践しようとすると、

「どの業務領域から導入すべきか?」

「現場の声と経営の方針をどう両立させるか?」

「文化として浸透させるためにどんな制度が必要か?」

といった壁に直面するケースも少なくありません。これは多くの企業が抱えている共通の課題なのです。

SHIFT AIでは、生成AIの活用・研修・展開に関する伴走支援を行っています。「どこから始めればいいかわからない」「全社展開するうえで、ルールや教育の整備が課題」といったお悩みに対して、現場視点に立った設計・支援を提供します。

法人向け支援サービス

「生成AIを導入したけど、現場が活用できていない」「ルールや教育体制が整っていない」

SHIFT AIでは、そんな課題に応える支援サービス「SHIFT AI for Biz」を展開しています。

AI顧問

活用に向けて、業務棚卸しやPoC設計などを柔軟に支援。社内にノウハウがない場合でも安心して進められます。

- AI導入戦略の伴走

- 業務棚卸し&ユースケースの整理

- ツール選定と使い方支援

AI経営研究会

経営層・リーダー層が集うワークショップ型コミュニティ。AI経営の実践知を共有し、他社事例を学べます。

- テーマ別セミナー

- トップリーダー交流

- 経営層向け壁打ち支援

AI活用推進

現場で活かせる生成AI人材の育成に特化した研修パッケージ。eラーニングとワークショップで定着を支援します。

- 業務直結型ワーク

- eラーニング+集合研修

- カスタマイズ対応

🔍 他社の生成AI活用事例も探してみませんか?

AI経営総合研究所の「活用事例データベース」では、

業種・従業員規模・使用ツールから、自社に近い企業の取り組みを検索できます。