「生成AIを導入したいが、プロンプトからの情報漏洩が怖くて踏み切れない」 「セキュリティ要件を厳しくしすぎて、現場から『使いにくい』と不満が出ている」

2026年、多くの企業が生成AIの全社展開に踏み切る中で、共通してぶつかる壁が「セキュリティ」です。最新の攻撃手法や流出インシデントのニュースを耳にするたび、担当者は「100%安全な運用」という正解のない問いに頭を抱え、完璧な対策が出来上がるまで活用のアクセルを緩めてしまう傾向があります。

しかし、AIという進化の速い技術において、「完璧主義」はむしろ最大の脆弱性になり得ます。

ルールを厳しくしすぎれば、現場の社員は利便性を求めて私用スマホでAIを使い始め、管理者の目が届かない「不感地帯(シャドーAI)」で深刻な漏洩が起きます。また、プロンプトインジェクションのような高度な技術的攻撃を日常業務のすべてにおいて完全に封じ込めようとすれば、AIの利便性は著しく損なわれ、組織の競争力は停滞します。

本記事では、身構えすぎている管理者のために、2026年における生成AIセキュリティの「現実的な落とし所」を提示します。100点満点の防御を目指して足を止めるのではなく、致命傷を避け、活用の成果を最大化するための「レジリエンス(回復力)」に基づいたガバナンスのあり方を、網羅的に解説します。

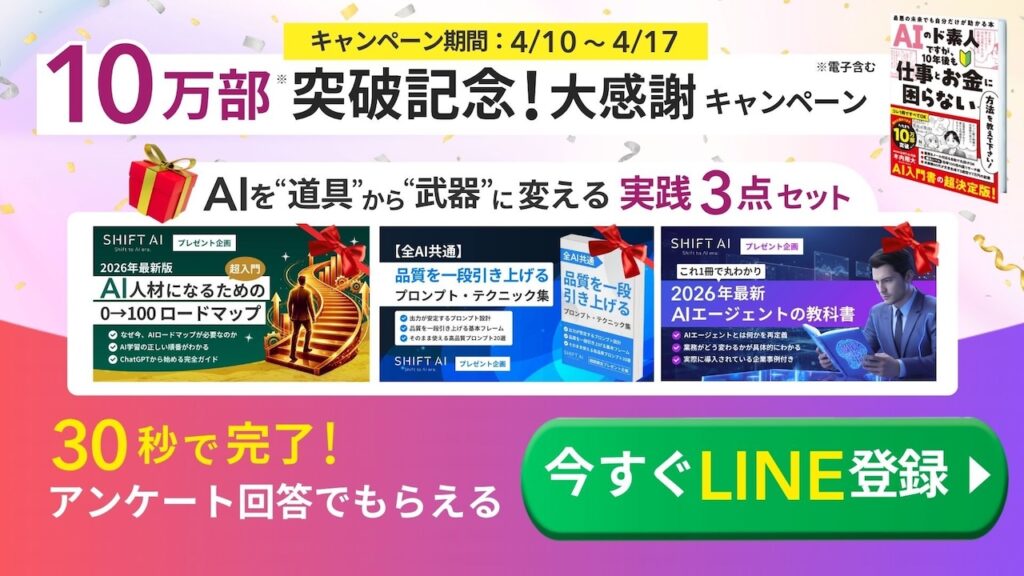

「必須ノウハウ3選」を無料公開

- 【戦略】AI活用を成功へ導く戦略的アプローチ

- 【失敗回避】業務活用での落とし穴6パターン

- 【現場】正しいプロンプトの考え方

2026年、プロンプトセキュリティを巡る「理想と現実」のギャップ

現在、生成AIを狙う攻撃はかつてないほど巧妙化しています。「プロンプトセキュリティ」という言葉が指す範囲は、単なるコピペによる流出対策を超え、以下の3つのような高度な脅威を含んでいます。

- 進化するプロンプトインジェクション: システムの制約を無視させ、機密情報を強制的に出力させる攻撃。

- リンクトラップと間接インジェクション: Webサイトを要約させた際、そのサイトに仕込まれた悪意ある命令(不可視のテキストなど)がAIを乗っ取り、ユーザーの情報を外部に送信させる手法。

- エージェント間通信の脆弱性: 複数のAIが自律的に連携する中で、一方のAIが「騙されて」別のAIに社内データを渡してしまうリスク。

こうした脅威に対し、多くのセキュリティベンダーは「ガチガチの防壁(フィルタリング)」を推奨します。しかし、ここに大きな「現実のギャップ」があります。

生成AIは、同じプロンプトでも回答が毎回変わる「非決定性」を持っています。どれほど強力なフィルタリングを導入しても、「言葉の組み合わせ」の無限のパターンを100%封じ込めることは技術的に不可能なのです。

「完璧」を追い求め、ルールを過剰に厳しくすれば、現場はAI活用を諦めるか、あるいは管理外の私用デバイスへ逃げ込みます。2026年のセキュリティ担当者に求められるのは、防壁の厚さを競うことではなく、「リスクをどう仕分けるか」という経営判断です。

身構えすぎないための「リスクの階層化」と優先順位

すべてのプロンプトに最高レベルのセキュリティを求めるのは現実的ではありません。業務内容に応じて「リスクの階層」を分け、対策に強弱をつけましょう。

レベル1:公開情報・一般業務(低リスク)

- 内容: 公開済みの自社プレスリリースの要約、一般的なビジネスメールの推敲など。

- 対策: 会社承認のAI環境(再学習オフ)であれば、特別な制限は不要。スピードを優先します。

レベル2:社内限定・特定プロジェクト(中リスク)

- 内容: 進行中のプロジェクトの資料作成、自社独自の課題解決の相談。

- 対策: 固有名詞や具体的な数値をそのまま入れない「情報の抽象化」を必須条件とします。

内部リンク: プロンプトの情報漏洩対策「線引き」の教科書|機密を隠して知能だけを借りる3つの技術

レベル3:極秘・個人情報(高リスク)

- 内容: 未発表の経営戦略、顧客の個人情報、独自のアルゴリズム。

- 対策: 物理的なマスキングツールの導入、または原則入力禁止。

ヒューマンエラーが致命傷になるため、システムによるガードを優先します。

現場を止めない「ちょうどいい」3つの現実的な守り方

2026年のAIガバナンスにおいて、最も避けるべきは「対策疲れ」による現場の形骸化です。社員の生産性を削がず、かつ致命的な事故を防ぐための、バランスの取れた3つの防衛策を提示します。

① ツールによる「うっかり」の物理的遮断

全社員に「完璧な注意」を求めるのは酷であり、非現実的です。人間は必ずミスをするという前提に立ち、システム側でセーフティネットを張ります。

- 法人版(Enterprise等)の徹底: 入力データが再学習に利用されない環境を「インフラ」として提供します。

- マスキングツールの導入: 氏名や電話番号といった「形式的な個人情報」は、送信前にツールで自動伏せ字化します。

内部リンク:プロンプトマスキングは万能か?セキュリティの盲点と、管理者が抱く「不安」の正体

※ツールで「形式」を機械的に守ることで、管理者の精神的負荷を劇的に軽減できます。

② 「攻撃者」よりも「不注意な身内」に焦点を当てる

最新のサイバー攻撃(プロンプトインジェクション等)への対策も重要ですが、日常業務における最大のリスクは、悪意のない社員による「過度な情報の流し込み」です。

外部からの高度な攻撃に対しては、WAF(Web Application Firewall)や専用のセキュリティフィルタといった「システム層」で対応し、社員が操作する「プロンプト層」では、あくまで情報の抽象化や取捨選択といったリテラシー教育にリソースを集中させましょう。

③ 「レジリエンス(回復力)」の構築

「事故をゼロにする」という不可能な目標を掲げるのをやめましょう。それよりも重要なのは、万が一不適切な入力をしてしまった際に、「即座に報告し、ログから削除・対応できる」体制と文化を整えることです。

隠蔽が最大の二次被害を生みます。「失敗を責めないが、報告の遅れは是正する」という文化こそが、AI時代のレジリエンス(回復力)の源泉となります。

まとめ|セキュリティは「止めるため」ではなく「アクセルを踏むため」にある

生成AIのプロンプトセキュリティに「これさえやれば100%安全」という終着点はありません。

しかし、リスクを階層化し、ツールと教育を適切に組み合わせることで、「コントロール可能な状態」に置くことは十分に可能です。ガバナンスの真の目的は、社員を縛ることではなく、社員が「ここまでなら安全だ」と確信を持ち、自らの知能をAIで拡張して最大成果を出すことにあります。

セキュリティを「アクセル全開で走るための高性能なブレーキ」として正しく機能させ、競合に先駆けたAI活用を推進していきましょう。

「最新の脅威が多すぎて、何から手を付けるべきか分からない」 「セキュリティと生産性のバランスをどう取ればいいのか?」

SHIFT AIでは、2026年の最新トレンドを踏まえた「現実的なAIガバナンス」を構築するための、法人向け実践カリキュラムを提供しています。

- Q2026年現在、最も警戒すべきプロンプト攻撃は何ですか?

- A

「間接プロンプトインジェクション」です。Webサイトやドキュメントを読み込ませる際、そこに仕込まれた見えない命令がAIを操作し、ユーザーの情報を外部へ送信させる手口です。信頼できない外部リソースを直接AIに読み込ませる際は、特に注意が必要です。

- Q小規模な会社でも高価なセキュリティフィルタリングを導入すべきですか?

- A

いいえ。まずは「再学習オフの法人版」を契約し、社員へのリテラシー教育を徹底することが先決です。高度なフィルタリングは、大規模組織や、機密情報を大量に扱う特定の部署から段階的に検討するのが現実的です。

- Qシステムプロンプトが漏洩すると、どのような実害がありますか?

- A

自社で構築したAIチャットボット等の「役割設定」や「参照データ」が盗まれ、競合に模倣されたり、AIを悪用(社内規定を無視させる等)されたりする恐れがあります。システム開発側での「入力チェック(ガードレール)」の設計が重要です。

- Q個人向けのChatGPT Plus等を使わせる場合、セキュリティ上の問題はありますか?

- A

あります。個人向けプランはデフォルトで学習設定がONになっていることが多く、社員が個別にオプトアウト設定を行わない限り、データが再学習に利用されるリスクがあります。管理の観点からは、管理者が一括制御できる「Team」や「Enterprise」プランの利用を強く推奨します。

- Qセキュリティ教育は、一度やれば十分でしょうか?

- A

AI技術の進化は非常に速いため、半年に一度程度の定期的なアップデートが必要です。特に「AIエージェント」のような新しい活用形態が登場した際は、それに伴う新しいリスク(エージェント間の予期せぬ通信など)について周知し直す必要があります。