AI技術は、私たちの生活やビジネスに革命をもたらす一方で、急速な進化と社会実装にはさまざまな課題が伴います。

本記事では、AIが抱える主な問題点を具体的な事例とともに、企業がAI導入を成功させるためのリスク対処法と実践的なアプローチを解説しているので、ぜひ参考にしてください。

「必須ノウハウ3選」を無料公開

- 【戦略】AI活用を成功へ導く戦略的アプローチ

- 【失敗回避】業務活用での落とし穴6パターン

- 【現場】正しいプロンプトの考え方

AIとは?いま注目される背景と役割

AI(人工知能)とは「Artificial Intelligence」の略で、人間の知的能力をコンピューターで模倣・再現する技術を指します。

例えば、音声認識や画像解析、言語生成、予測分析など、人間が行う複雑な判断や処理を自動で実行できるのが特徴です。

近年のAI技術は、ディープラーニングや大規模言語モデル(LLM)などの進歩により、精度と応用範囲が飛躍的に拡大しております。業務効率化や人手不足の解消、データ活用による新しい価値の創出といった目的で、医療・金融・製造・教育など多様な業界で導入が進んでいます。

デジタル変革を支える中核技術として、AIは今まさに社会全体で存在感を増しており、将来的にも活用の幅はますます広がっていくでしょう。

AI導入の主要な問題点

AI技術の社会実装が進む中で、潜在的なリスクや懸念点が指摘されています。ここでは主な問題点を詳しく解説します。

バイアスの問題|学習データの偏りによる差別的判断

AIのバイアス問題とは、AIが学習する際に使用するデータやアルゴリズム自体に偏りが含まれていることで、結果として不公平な判断を下してしまう現象を指します。

特に人種や性別、年齢といった属性に関するバイアスが問題視されており、AIがそれを学習してしまうことで、知らず知らずのうちに差別的な振る舞いをすることがあります。

例えば、採用選考やローンの与信審査にAIを活用した場合、過去のデータに基づいて特定の属性を不利に扱う傾向が強まると、本来平等に評価されるべき応募者や申請者が不利益を被るおそれがあるのです。

こうしたバイアスはAIによる回答の精度や信頼性を損ねるだけでなく、企業や組織の社会的信用にも大きな影響を与えかねません。そのため、AIを導入する際には、学習データの品質や構成に細心の注意を払うとともに、バイアスを検知・是正する仕組みの整備が不可欠とされています。

プライバシー侵害|個人情報の過剰収集と監視社会化

AIによる高精度な分析をするためには、大量のデータ収集が必須です。しかし、その中には氏名や住所、行動履歴、顔写真といった個人情報が含まれることがあり、適切に管理されなければプライバシー侵害になる可能性があります。

特に顔認識AIや監視カメラと連携したシステムにより、本人が意図しないまま行動や位置情報が収集・解析されるおそれがあるのです。こうした技術の普及や進展は、利便性の向上と引き換えに、新たな課題をもたらすケースがあります。

説明責任と透明性の欠如(ブラックボックス問題)

ディープラーニング(深層学習)のような高い技術のAIは、膨大なデータをもとに自ら判断基準を構築します。しかし、それまでの過程が非常に複雑なので、出された結果の根拠を人間が理解・説明するのが難しいという問題があります。

これはいわゆる「ブラックボックス問題」と呼ばれており、AIがどのようにして判断に至ったのかが不明なままでは、ユーザーや関係者に対する説明責任を果たせません。

誤った判断が起きた際の原因究明が困難になり、結果としてAIの信頼性や社会的に受け入れられないことになってしまいます。

責任の所在の曖昧さ|事故や誤判断の責任は誰が負う?

AIを用いた意思決定や自律的なシステムの導入が進む中で、「もしAIが誤った判断をして損害が発生した場合、その責任は誰が負うのか」という問題が浮上しています。

AIは開発者や提供者、利用者など複数の関係者が関わるため、責任の所在が明確になりにくく、被害が生じた際の救済や再発防止策の策定が困難になるかもしれません。

関連記事:【事例8選】AIの倫理的問題を徹底解説|企業が直面するリスクとは

雇用への影響|仕事の代替と社会的不安

AIやロボットによる業務の自動化が進むことで、生産性や業務効率は向上しますが、反対に人間の仕事が減少し、特定の職種では失業リスクが現実的な課題となりつつあります。

特にルーチンワークや定型業務はAIによって代替されやすく、中〜低技能の職種を中心に「AIに仕事を奪われるのではないか」という不安が広がっています。

AI技術が今後さらに普及し、職場や日常生活にも深く浸透していけば、人間が自らの頭で考えたり判断したりする機会が減少する可能性があるかもしれません。

単に雇用の問題にとどまらず、人間の思考力や創造性に対する依存度の低下といった社会的なデメリットにもつながりかねません。このような状況に対応するためには、AIに代替されにくい創造的・戦略的な業務へのシフトやスキルアップ・リスキリングが必要不可欠です。

AI人材の不足|導入・運用を支える専門人材の欠如

AIの導入が進む一方で、それを実際に開発・運用できるAI人材の不足が深刻な課題となっています。AIモデルの設計・構築・運用保守に加えて、データ設計やプロジェクト管理を担える人材は限られており、特に中小企業では「AIを導入したくても扱える人がいない」といった状況に直面しています。

また近年、AI人材は国内外で獲得競争が激化しており、採用の難しさや人件費の高騰に加え、自社での育成にも多くの時間とコストがかかるため、外部委託に頼らざるを得ない企業も少なくありません。

しかし、外注だけではノウハウが社内に蓄積されず、継続的に利用するのが難しくなるという問題もあります。

さらに、AIを単なる技術として捉えるのではなく、自社のビジネス課題にどう結びつけて活かすかという視点が求められるため、エンジニアだけでなくビジネス実装に長けた人材の獲得や育成も不可欠です。

AIの問題点に関する具体的な事例5選

AIに関して実際に起こった問題点を5つまとめました。

- Clearview|AIの顔認識とプライバシー侵害

- Amazon|AI採用システムが女性を差別

- COMPAS|刑事司法におけるバイアス問題

- Uber|自動運転車が歩行者を死亡させた事故

- 偽CFOとのAIビデオ会議で38億円送金|香港の深刻なディープフェイク詐欺

事例1:Clearview AIの顔認識とプライバシー侵害

アメリカの企業Clearview AIは、SNSやWebサイト上に公開された顔写真を本人の同意なく集め、巨大な顔認識用データベースを構築していたことで国際的なニュースとなりました。

このデータは主に法執行機関向けに提供されており、数十億件に及ぶ顔画像が含まれていたとされています。

2022年には、イギリスの個人情報保護監督機関(ICO)が、同社の行為が同国のデータ保護法に違反すると判断し、約12億円の罰金を科すとともに、英国内の個人データの削除とサービス提供の中止を命じました。

出典:英当局、顔認識テクノロジーの「Clearview AI」に罰金12億円

事例2.AmazonのAI採用システムが女性を差別

アマゾンは2014年頃から、採用業務の効率化を目的に、エディンバラに設けたエンジニアチームによって独自のAI採用システムを開発していました。このシステムは、機械学習を活用し、履歴書に含まれるおよそ5万個のキーワードを解析して、自社に最も適した人材を自動で抽出するというもので、わずか数秒で最良とされる5名ほどの候補者を選び出す性能を持っていました。

しかし開発が進む中で、AIが男性応募者を一方的に高く評価し、女性を不利に扱う傾向があることが発覚しました。これは、学習に使われた過去の採用データに男性が多く含まれていたことが原因とされ、AIがその傾向をそのまま学習してしまったと考えられています。

実際、「女性」という単語や、「女性チェスクラブへの所属歴」などがある応募者は、自動的に選考から除外されるケースが確認され、女子大卒の求職者が落とされた事例も報告されました。

アマゾンは最終的にこのAIの使用を停止し、開発を中止しました。AIの判断が必ずしも中立ではないことを示す象徴的な事例です。

出典:焦点:アマゾンがAI採用打ち切り、「女性差別」の欠陥露呈で

事例3.COMPASによる刑事司法におけるバイアス問題

米国の刑事司法で再犯リスク予測に用いられていたAIシステム「COMPAS」は、黒人被告に対して白人被告よりも再犯リスクを高く評価する傾向があることが指摘されました。

このバイアスは、過去の逮捕履歴や社会経済的背景といったデータが反映された結果であるとされています。さらに、COMPASのアルゴリズムが非公開であったため、その判断の根拠が不透明であり、信頼性を損なう要因となりました。

この事例はAIが人間の判断に影響を与える可能性と、透明性の欠如がもたらす問題を示しています。

出典:アルゴリズムと公正

事例4.Uberの自動運転車が歩行者を死亡させた事故

2018年、米アリゾナ州でウーバーの自動運転車両が歩行者を死亡させた事故は、自動運転技術の限界を浮き彫りにする重大な事例となりました。

米国家運輸安全委員会の調査によれば、事故当時、AIは道路上に人がいる状況を想定しておらず、最後まで対象を「歩行者」と認識することができませんでした。さらに、緊急ブレーキが作動しなかったなど、複数のシステム上の欠陥が連鎖的に重なっていたことが判明しています。

この運転失敗の事故は、初の歩行者死亡事故としても記録され、AIによる自律的な判断と安全確保の課題が改めて問われる結果となりました。

出典:「最後まで人間だと認識できず」UberのAI車、初の死亡事故が起きた理由

事例5.偽CFOとのAIビデオ会議で38億円送金|香港の深刻なディープフェイク詐欺

2024年、香港でディープフェイク技術を用いた大規模な詐欺事件が発生しました。詐欺グループはAIで生成された偽のCFO(最高財務責任者)とのビデオ会議を通じて、被害者を信じ込ませ、38億円もの多額の送金をさせたのです。

この事例は、生成AIの進化が悪用されることで、従来の詐欺手口がより巧妙化し、企業や個人が甚大な被害を被るリスクがあることを示しています。

出典:会計担当が38億円を詐欺グループに送金、ビデオ会議のCFOは偽物 香港

AI導入に伴うリスクへの対処方法

AI導入の効果を最大限に発揮するためには、企業が主体的にリスク管理と内部対策を行うことが必要です。

企業によるリスク管理と内部対策を行う

AIを効果的に活用するためには、企業がリスクを適切に管理する体制を整えることが必要です。そのためにはまず、AIに関連する法律や規制の最新動向を常に把握し、コンプライアンスを徹底する必要があります。

また、AIモデルの設計・運用においては、公平性や透明性を意識した開発を行うのが前提です。さらに、リスク対策を社内でガイドラインとして明文化し、関係者全員に対して継続的な教育や研修を行うことで、組織全体のAIリテラシーを高める取り組みが重要です。

AIに関する日本の法規制を理解する

日本政府は、AIの健全な発展と利用を促進するため、2019年に「人間中心のAI社会原則」を策定しました。

| 原則名 | 概要(簡略説明) |

| 人間中心の原則 | AIは人間の能力や創造性を補助・拡張する高度な道具であるべき |

| 教育・リテラシーの原則 | AI弱者を生まないように、すべての世代に学びの機会を提供する必要がある |

| プライバシー確保の原則 | 個人の自由や尊厳が侵害されないよう、パーソナルデータの取り扱いには最大限の配慮が求められる |

| セキュリティ確保の原則 | AI利用のリスクを正しく評価・低減し、サイバーセキュリティを含むリスク管理を進める必要がある |

| 公正競争確保の原則 | 特定国や企業にAIリソースが集中し、支配的な立場で不当な行為を行うことを防止すべき |

| 公平性・説明責任・透明性(FAT)の原則 | AIによる不当な差別を防ぎ、すべての人が公平に扱われる設計と説明責任が必要。 |

| イノベーションの原則 | 国境や立場を越えて多様な人材・知識を活かし、Society 5.0に向けた継続的なイノベーションを目指す。 |

企業はこれらの原則を深く理解し、自社のAI導入・運用に組み込むことで、リスクを低減し、社会からの信頼を得られます。

教育とトレーニングの重要性を考える

AI技術の発展に伴い、企業においても教育とトレーニングの重要性がますます高まっています。顧客のニーズに的確に応えるためには、新しい技術を正確に理解し、社員が基礎から応用までの知識を体系的に習得して実務に直結するスキルを身につけることが大切です。

特にAIの利用においては、従業員が著作権や個人情報保護といったルールを理解し、法的・倫理的観点からの判断が求められます。

そのため、最新の技術動向に対応した段階的な研修プログラムの導入が不可欠です。その他にも、社員一人ひとりの作業内容や習熟度に応じて学習内容をカスタマイズし、役割に応じたトレーニングを実施することで、より実効性の高い教育が可能になります。

全社的なAIリテラシーの向上に向けた継続的な支援は、長期的に見て競争力の強化と顧客満足度の向上につながる重要な取り組みです。

企業がAIを導入を成功させるための方法

AI導入を成功させるためには、技術を導入するだけでなく、戦略的なアプローチ方法と準備が大切です。ここでは4つのポイントをまとめました。

1. 現状の業務課題を明確化する

AI導入前に、自社のどの業務に課題があるかを具体的に洗い出し、改善したい点を整理します。ナレッジの共有や業務の可視化も並行して行うと効果的です。

以下のような視点から検討しましょう。

<段階的な導入(PoCから開始)>

全社展開の前に、小規模なPoC(概念実証)を実施し、AIの有効性やリスクを検証します。成功事例や失敗要因を把握し、スムーズな本格導入につなげます。

<社内推進体制の構築>

経営層と現場の橋渡し役として、AIに詳しいプロジェクトリーダーを置き、導入の指示系統や意思決定を明確化します。

<従業員への教育と意識改革>

AIリテラシー向上のための研修やeラーニングを活用し、「AIは仕事を奪うもの」ではなく「業務を補助するもの」という理解を社内に浸透させます。

<KPI設計と評価の仕組みづくり>

導入後は効果を測定するための指標(KPI)を設け、定期的に運用成果を評価します。改善が必要な場合は速やかに対応します。

<外部パートナーとの連携>

社内に十分なスキルがない場合は、信頼できるAIベンダーやコンサルティング企業と連携し、的確なアドバイスや支援を受けます。

<ミスの防止とルール整備>

AIの判断ミスや誤作動による影響を最小限に抑えるため、ルール・ガイドラインを整備し、運用中のトラブルに備えた体制を構築します。

<創造性を引き出す仕組みづくり>

AIは効率よくする手段だけではなく、従業員がより価値の高いアイデアや戦略を生み出す時間を確保できるよう、役割の再設計も検討します。

2. PoC(概念実証)で効果を検証する

AI導入を成功させるには、いきなり全社展開を図るのではなく、まずはPoC(Proof of Concept:概念実証)で効果を検証することが重要です。

例えば、チャットボットによる問い合わせ対応や、需要予測ツールの活用といった限定的な業務領域から始めることで、AIがどの程度役立つのかを数値データで評価できます。

最近では、OpenAIのChatGPTをマーケティング支援に活用する企業も増えており、コンテンツ生成や顧客対応の最適化にDX推進の一環として導入する事例も多く見られます。

PoCの結果をもとに、費用対効果や業務適合性を検討し、段階的な導入へとつなげていくアプローチがおすすめです。

3. 社内のAI人材を育成・確保する

AI導入を本格的に進めるためには、外部の専門家に任せきりにするのではなく、社内にもAIの基本を理解し、活用できる人材をしっかりと確保することが重要です。

特にAI未経験の社員に対しては、リスキリング研修やeラーニングを活用し、段階的に知識とスキルを身につけさせる取り組みがおすすめです。

近年では、経済産業省が推進する「リスキリング支援事業」などの制度を採用し、教育負担を軽減しながら人材育成を進める企業も増えています。AIに関連する知識は幅広く、学習内容の設定や習熟度チェック、社内での活用方法の作成など、さまざまな部分において継続的な支援を行える体制が、AI導入効果を大きく左右します。

4. 信頼できるAIベンダー・パートナーと連携する

AI導入を成功させるためには、社内の努力だけでは補いきれない部分も多く、信頼できるAIベンダーやコンサルティング企業との連携が欠かせません。経験豊富な外部パートナーなら、自社に不足しているノウハウやプログラミングスキルを補完し、最適な導入プランの提案やネットワーク構築までサポートしてくれます。

自社の業務環境やレベルに合わせたシステム構築ができる点もメリットです。

また、AI活用において浮かび上がる課題に対しても、さまざまなアイデアを提供してくれるため、具体的な実現性を高められます。

ただし、複数のベンダーを比較し、自社の目的や課題解決に最も適したパートナーを選定することが重要です。プロジェクトの成功には、ベンダーとの信頼関係と連携が関わっており、外部の知見を取り入れることで、AI活用の加速が期待できるでしょう。

まとめ:AIの問題点を理解して活用を進めよう

AI技術は業務の効率化や顧客情報の分析など、多くの場面で便利に活用され始めています。しかし一方で、AIに入力された機密情報が漏洩する危険性や、サイバー攻撃によるリスク、誤作動による判断ミスなどの危険も存在します。

さらに、AIソフトウェアを適切に運用するには専門的な知識と経験が必要で、サポート体制の整備も不可欠です。AIの導入はただのツールではなく、業務全体に関わる戦略的な取り組みで、成功するには信頼できるパートナーの存在が大きなカギとなります。

下記リンクからは、自社の生成AI活用力を自己診断し問題点を把握できるチェックリストをご覧いただけます。「自社の生成AIへの対応状況を可視化したい」「生成AIの活用に向けて、自社に不足している点を認識したい」といった方はお気軽にご覧ください。

またSHIFT AIでは、AI導入に関するお悩みや注意点にもしっかり寄り添い、得意とするeラーニングやコンサルティングを通じて、貴社に最適なAI活用をサポートしています。機密性の高い顧客情報を扱う企業様にも安心して導入いただける体制を整えていますので、ぜひお気軽にご相談ください。

法人向け支援サービス

「生成AIを導入したけど、現場が活用できていない」「ルールや教育体制が整っていない」

SHIFT AIでは、そんな課題に応える支援サービス「SHIFT AI for Biz」を展開しています。

AI顧問

活用に向けて、業務棚卸しやPoC設計などを柔軟に支援。社内にノウハウがない場合でも安心して進められます。

- AI導入戦略の伴走

- 業務棚卸し&ユースケースの整理

- ツール選定と使い方支援

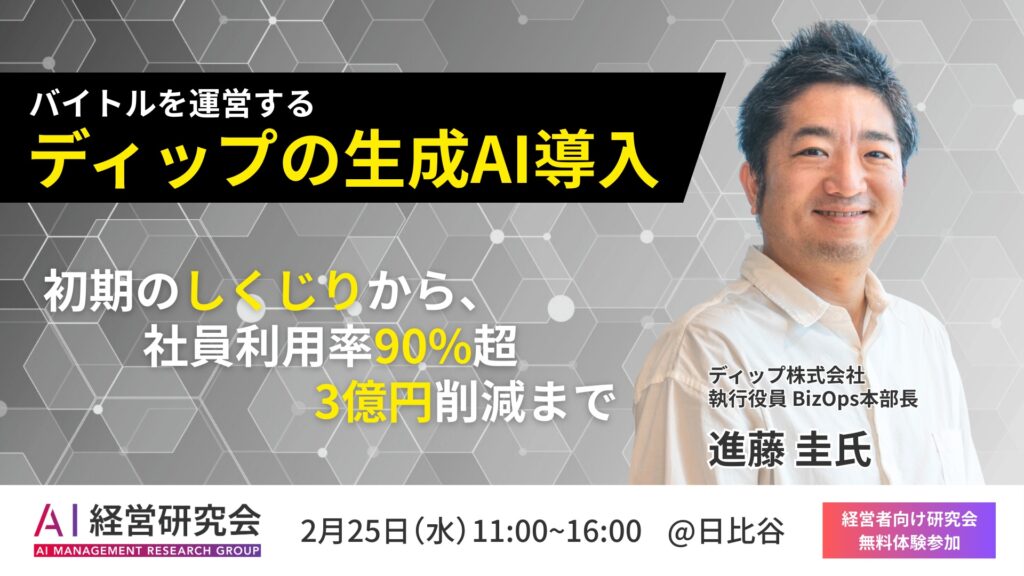

AI経営研究会

経営層・リーダー層が集うワークショップ型コミュニティ。AI経営の実践知を共有し、他社事例を学べます。

- テーマ別セミナー

- トップリーダー交流

- 経営層向け壁打ち支援

AI活用推進

現場で活かせる生成AI人材の育成に特化した研修パッケージ。eラーニングとワークショップで定着を支援します。

- 業務直結型ワーク

- eラーニング+集合研修

- カスタマイズ対応